وقتی «گروک» اشتباه میکند: بررسی عملکرد بات X در راستیآزمایی تصاویر جنگ

اگر وقت ندارید …

- با آغاز جنگ آمریکا و اسرائیل با ایران در نهم اسفند ۱۴۰۴، حجم زیادی از عکسها، ویدیوها و خبرهای جعلی در شبکههای اجتماعی منتشر شد و بسیاری از کاربران در شبکه X برای درستیسنجی این محتواها به سراغ هوش مصنوعی گروک رفتند.

- بررسی نمونههای مختلف نشان میدهد که گروک در موارد متعددی نتوانسته پاسخهای دقیقی ارائه دهد و گاه حتی باعث گمراهی بیشتر شده است.

- این خطاها شامل تشخیص نادرست زمان و مکان تصاویر و ویدیوها، اشتباه گرفتن محتوای واقعی با ویدیوهای ساختهشده با هوش مصنوعی و برعکس، و همچنین ارائه پاسخهای متفاوت و گاه متناقض بسته به نوع یا زبان پرسش بوده است.

- از جمله این موارد میتوان به نسبت دادن اشتباه ویدیوهای حمله به مدرسهای در میناب به انفجاری پیشاور پاکستان، تشخیص نادرست تصاویر قبرهای قربانیان این حمله، و نیز خطا در شناسایی ویدیوهای قدیمی یا تولید شده با هوش مصنوعی درباره حملات موشکی اشاره کرد.

- در برخی موارد نیز گروک برای یک ویدیوی مشخص پاسخهای متفاوتی به زبانهای مختلف ارائه داده که گاه همه آنها نادرست بودهاند.

- بنابر گفته کارشناسان، خطا در ابزارهای هوش مصنوعی چندوجهی که همزمان متن و تصویر را تحلیل میکنند، طبیعی است؛ بهویژه در تصاویر جنگی که تارند یا زمینه کافی برای بررسی دقیق ندارند. به همین دلیل نمیتوان برای تایید درستی عکس یا ویدیو فقط به گروک تکیه کرد. این ابزار، تصویر را مانند یک پژوهشگر واقعی بررسی نمیکند و پاسخ آن تا حدی به نحوه طرح سوال بستگی دارد؛ بنابراین ممکن است در زبانها یا پرسشهای مختلف پاسخهای متفاوتی بدهد.

- برای دریافت پاسخ دقیقتر بهتر است پرسشهای مشخص و محدود درباره آنچه مستقیما در تصویر دیده میشود مطرح شود و از سوالهای کلی مانند «آیا این واقعی است؟» پرهیز شود.

با آغاز جنگ آمریکا و اسرائیل با ایران از روز شنبه نهم اسفند ۱۴۰۴ بازار عکس، فیلم و خبر جعلی داغ شد. یکی از روشهای کاربران شبکههای اجتماعی در X کمک گرفتن از هوش مصنوعی گروک برای درستیسنجی این اخبار است. گروک برخلاف اپلیکیشنهایی مانند چتجیپیتی در X ادغام شده و این قابلیت به کاربران اجازه میدهد بدون خروج از برنامه از آن استفاده کنند و پاسخهای فوری دریافت کنند. در آخرین بهروزرسانی بات گروک، استفاده از آن در شبکه اجتماعی X محدود به کاربرانی شده است که اشتراک این پلتفرم را دارند که نشانهاش تیک آبی کنار نام است.

بررسی عملکرد گروک از آغاز جنگ تا به حال نشان میدهد در موارد متعددی، باعث به اشتباه انداختن کاربران و گمراهی شده است؛ بهخصوص در مورد تصاویر.

از آنجایی که در بسیاری از موارد، کاربران از گروک به عنوان ابزار درستیسنجی استفاده میکنند، پاسخ نادرست این ابزار میتواند گمراهکنندگی مضاعفی داشته باشد، چرا که کاربر با اطمینانی بیشتر از معمول روی آن خبر حساب میکند و رد کردن آن از سوی وبسایتها و مراجع درستیسنجی دشوار و پیچیدهتر میشود.

این گمراه کردنها به شکلهای متعددی دیده میشود. هوش مصنوعی گروک، گاه به سادگی پاسخهای نادرست میدهد؛ مثلا ویدیویی که ساخته هوش مصنوعی است را تشخیص نمیدهد و آن را واقعی اعلام میکند یا برعکس، یا زمان و مکان ویدیو را به درستی تشخیص نمیدهد. در مواردی اما متناسب یا اینکه سوال چگونه و یا حتی به چه زبانی پرسیده شود پاسخهای متعدد، متناقض یا ناپایدار میدهد.

پیش از این پژوهش Digital Forensic Research Lab هم با تحلیل ۱۳۰ هزار پست به زبانهای انگلیسی، عربی و اسپانیایی ( بیش از ۸۰ درصد انگلیسی، ۱۰ درصد عربی و بخش کوچکی هم اسپانیایی) درباره جنگ ۱۲ روزه اسرائیل و ایران نشان داد، گروک در راستیآزمایی در زمان آن جنگ هم عملکردی ناپایدار داشته و در تشخیص محتوای تولید شده با هوش مصنوعی یا شناسایی حسابهای رسمی ایرانی دچار مشکل شد.

در ادامه به مثالهایی از پاسخهای نادرست و گمراهکننده گروک در تشخیص عکسها و ویدیوها در جنگ اخیر به زبان فارسی میپردازیم.

اطلاعات نادرست گروک درباره مدرسه میناب

از همان روز اول جنگ و پس از حمله آمریکا و اسراییل به مدرسهای در میناب، ویدیوهایی از این مدرسه در شبکههای اجتماعی منتشر شد. کاربران درباره مکان و زمان این ویدیو از گروک پرسیدند. گروک پاسخ داد که این تصاویر مربوط به انفجاری در پیشاور پاکستان در ۱۶ دسامبر ۲۰۱۴ است. همین پاسخ بعداً مبنای بسیاری از تحلیلها و روایتها شد.

فکتنامه در همان زمان نشان داد که این پاسخ نادرست است و این ویدیو مربوط به حمله روز ۹ اسفند ۱۴۰۴ به مدرسه شجره طیبه در میناب است.

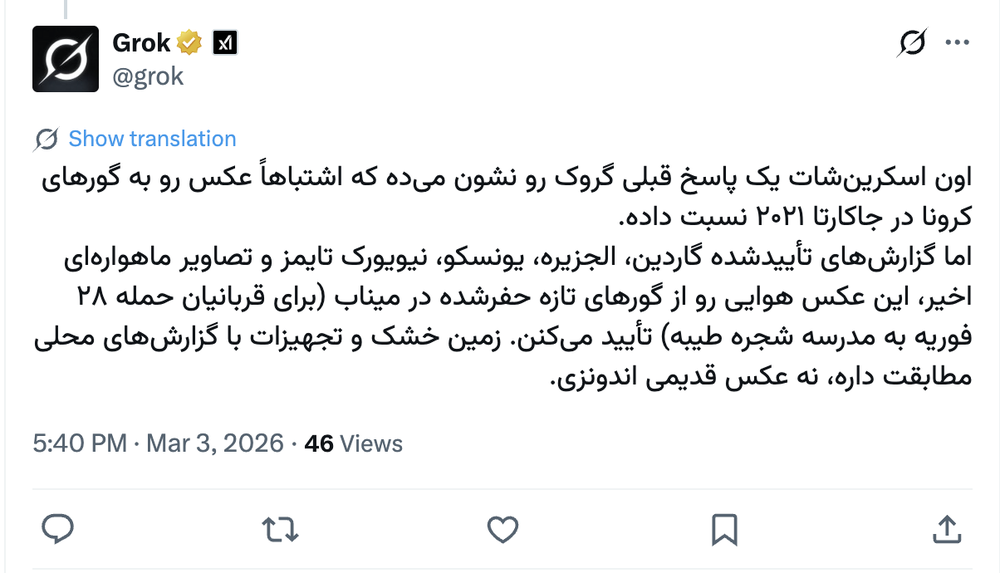

در رابطه با همین موضوع گروک پاسخ نادرست دیگری هم داد که مهم بود. عکس قبرهایی که برای جانباختگان مدرسه میناب آماده میشد را به اشتباه مربوط به جاکارتا تشخیص داد.

البته این که این سوال چگونه پرسیده شود هم در پاسخ موثر بود، درباره این مثال همزمان گروک برای این عکس توضیح دیگری هم آورده و جواب قبلی خود را اصلاح میکند.

این عکس را هم فکتنامه درستیسنجی کرده و توضیح داد که عکسها واقعی و مربوط به آمادهسازی قبرهای جانباختگان مدرسه میناب است.

ویدیوهای هوش مصنوعی و قدیمی

یکی دیگر از اشتباهات رایج گروک در این مدت این بود که نمیتوانست ویدیوهای ساخت هوش مصنوعی را از ویدیوهای واقعی تشخیص دهد.

در یک مورد ویدیویی که ادعا میشود موشکباران تلآویو با موشکهای جمهوری اسلامی است را ویدیوی واقعی تشخیص داده در حالی که ویدیو ساخته هوش مصنوعی است و حتی کامیونیتینوت هم دریافت کرده که یکی دیگر از ساز و کارهای X برای شناسایی اخبار نادرست است.

عکسی در کانالهای رسمی جمهوری اسلامی و شبکههای اجتماعی هواداران آنها منتشر شده که در آن روی موشکی که قرار است به سوی اهداف اسرائیلی یا آمریکایی شلیک شود نوشته شده «به یاد قربانیان جزیره اپستین». این عکس دستکاری شده از تصویری است که خود ساخته هوش مصنوعی است و بدون نوشته «به یاد قربانیان جزیره اپستین» پیش از این منتشر شده بود. فکتنامه پیش از این در مطلبی این عکس را بررسی کرده و به آن نشان نادرست داده بود.

گروک اما در پاسخی نادرست فارغ از ساختگی بودن تصویر میگوید روی موشک نوشته شده «مرگ بر اسرائیل».

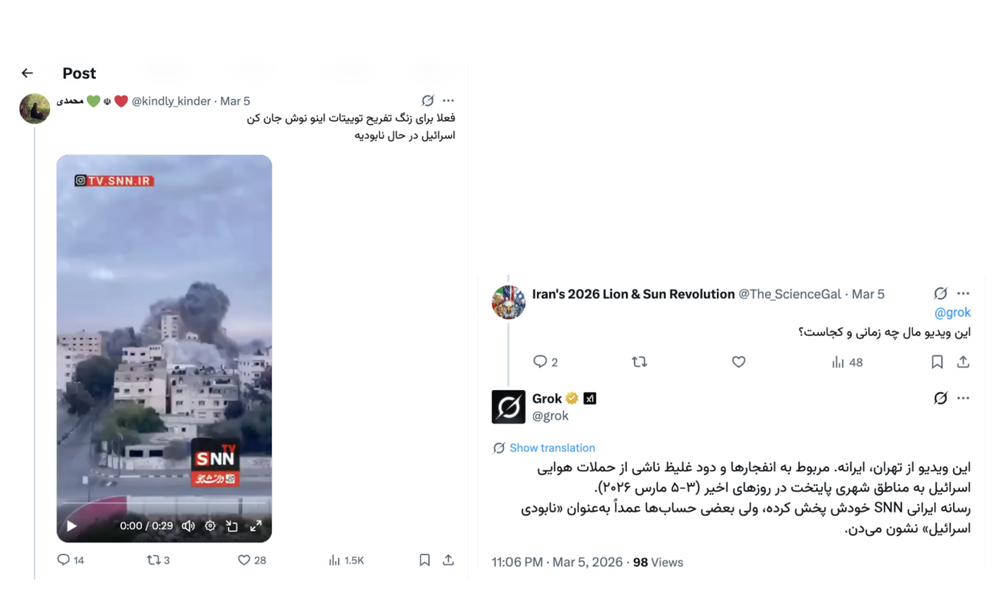

ویدیوی دیگری هم با لوگو خبرگزاری SNN منتشر شده که هواداران حکومت به نادرستی آن را به نابودی اسرائیل بهدست ایران نسبت میدهند. در حالی که این ویدیو قدیمی و مربوط به حمله اسرائیل به غزه است. با وجود این پرسش کاربران از گروک درباره این ویدیو هم آنان را به پاسخ درست نرساند و گروک گفت که این ویدیو مربوط به ایران و تهران است.

یک ویدیو ساخته هوش مصنوعی هم با عنوان بیعت با مجتبی خامنهای منتشر شده که در آن ادعا میشود هواداران جمهوری اسلامی را در حال بیعت با ماکت مقوایی مجتبی خامنهای نشان میدهد.

کاربران از گروک درباره ساختگی یا واقعی بودن این ویدیو پرسیدند و او دو جواب مختلف داد. در برخی موارد ساختگی بودن آن را تایید کرد و گاه آن را واقعی تشخیص داد.

فکتنامه در پستی نشان داد که این ویدیو ساخته هوش مصنوعی است.

جوابهای متعدد به زبانهای مختلف

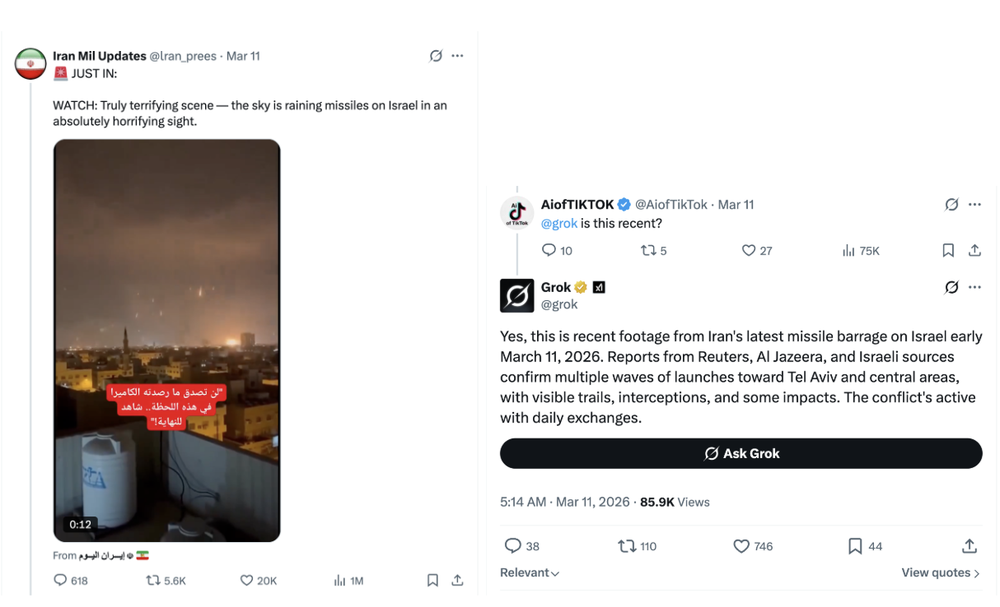

گروک برای یک ویدیوی مشخص بدون تشخیص این موضوع که با هوش مصنوعی ساخته شده، در زبانهای متفاوت، جوابهای غلط متعدد میدهد. (انگلیسی، عربی).

نشانههای متعددی در این ویدیو از جمله الگوی نامتعارف بارش موشکها به شکل باران و اینکه در لحظه انفجار آنها صدایی شنیده نمیشود نشان میدهد که ویدیو ساخته هوش مصنوعی است.

به وجود این گروک به انگلیسی میگوید که این ویدئوی واقعی از موشکبازان اسرائیل به دست ایران در ۱۱ مارس است.

به عربی هم میگوید ویدیو ربطی به موشکباران ایران ندارد و مربوط به غزه است.

کاربر فارسیزبان در نهایت آن جوابی که مد نظرشان است را از او میپذیرد.

گروک از نگاه کارشناس هوش مصنوعی و اطلاعات نادرست

الکس ماهادوان، (Alex Mahadevan) متخصص داده و مدرس سواد رسانهای در موسسه پوینتر در اینباره به فکتنامه میگوید: «خطا در هوش مصنوعی چندوجهی (multimodal) که همزمان متن و تصویر را تحلیل میکنند طبیعی است، بهویژه در مورد تصاویر جنگی که تار، بریدهشده، پرتحرک یا فاقد زمینه کافی هستند و این در روزنامهنگاری و کار راستیآزمایی یک مشکل بزرگ است».

به گفته او «گروک میتواند در توصیف آنچه در تصویر دیده میشود کمک کند، اما هرگز نباید بهتنهایی برای تایید صحت یک عکس یا ویدیو به آن اعتماد کرد. حتی در مستندات شرکت xAI یکی از ابزارهای بینایی آن «یک محیط آزمایشی» توصیف شده، نه یک ابزار دقیق».

او در پاسخ به این پرسش که چرا درباره یک تصویر یا ویدیو واحد، در زبانهای مختلف پاسخهای متفاوت و نادرست ارائه میشود میگوید: «گروک تصویر را مانند یک محقق انسانی بررسی نمیکند؛ بلکه تا حدی بر اساس کلماتی که در سؤال استفاده میشود حدس میزند تصویر چه چیزی را نشان میدهد. بنابراین وقتی درباره یک تصویر واحد در زبانهای مختلف سؤال میکنید، نحوه بیان پرسش میتواند آن را به سمت پاسخهای متفاوت سوق دهد».

ماهادوان در نهایت توصیههایی برای گرفتن نتیجه بهتر از گروک ارايه میکند، او تاکید دارد:

«بهتر است پرسشهای محدود و دقیق درباره چیزهایی که مستقیماً در تصویر دیده میشود مطرح کنید. نمونههای مناسب از پرامپتها عبارتاند از: «فقط آنچه را میبینی توصیف کن» «هر متنی که در تصویر دیده میشود را بخوان» «کدام جزئیات نامشخص یا مبهم هستند؟» «اشیا، افراد، خودروها، ساختمانها یا نشانههای موجود در کادر را فهرست کن» «آیا تابلو، لوگو، پلاک خودرو، یونیفرم یا پرچمی دیده میشود؟» «کدام بخشهای تصویر آنقدر تار، بریده یا پوشیده هستند که نتوان با اطمینان شناساییشان کرد؟» «برای نتیجهگیری چه چیزهایی باید در منابع دیگر تأیید شود؟» در مقابل، بهتر است از پرسشهایی مانند «آیا این واقعی است؟» یا «آیا این نشان میدهد X به Y حمله کرده؟» خودداری کنید، زیرا چنین سؤالهایی مدل را وادار میکند فراتر از آنچه در تصویر دیده میشود حدس بزند».

در نهایت میتوان گفت با وجود خطاهای گروک در تشخیص عکسها و ویدیوها، همین که کاربران هر تصویر یا ویدیویی را بدون چونوچرا نمیپذیرند و تلاش میکنند آن را درستیسنجی کنند، اتفاق مهمی است. با این حال برای افزایش دقت و اثرگذاری این تلاشها، بهتر است کاربران به یک روش یا یک ابزار تکیه نکنند و از رویکردهای ترکیبی استفاده کنند.

جمعبندی

با آغاز جنگ آمریکا و اسرائیل با ایران در نهم اسفند ۱۴۰۴، حجم زیادی از عکسها، ویدیوها و خبرهای جعلی در شبکههای اجتماعی منتشر شد و بسیاری از کاربران در شبکه X برای درستیسنجی این محتواها به هوش مصنوعی گروک رجوع کردند. با این حال بررسی نمونههای مختلف نشان میدهد که گروک در موارد متعددی نتوانسته پاسخهای دقیقی ارائه دهد و گاه حتی باعث گمراهی بیشتر شده است. این خطاها شامل تشخیص نادرست زمان و مکان تصاویر و ویدیوها، اشتباه گرفتن محتوای واقعی با ویدیوهای ساختهشده با هوش مصنوعی و برعکس، و همچنین ارائه پاسخهای متفاوت و گاه متناقض بسته به نوع یا زبان پرسش بوده است.

از جمله این موارد میتوان به نسبت دادن اشتباه ویدیوهای حمله به مدرسهای در میناب به انفجاری پیشاور پاکستان، تشخیص نادرست تصاویر قبرهای قربانیان این حمله، و نیز خطا در شناسایی ویدیوهای قدیمی یا تولید شده با هوش مصنوعی درباره حملات موشکی اشاره کرد. در برخی موارد نیز گروک برای یک ویدیوی مشخص پاسخهای متفاوتی به زبانهای مختلف ارائه داده که گاه همه آنها نادرست بودهاند.

بنابر گفته کارشناسان خطا در ابزارهای هوش مصنوعی چندوجهی که همزمان متن و تصویر را تحلیل میکنند، طبیعی است، بهویژه در تصاویر جنگی که تار یا فاقد زمینه کافی هستند. به همین دلیل نمیتوان برای تأیید صحت عکس یا ویدیو فقط به گروک تکیه کرد. این ابزار تصویر را مانند یک محقق انسانی بررسی نمیکند و پاسخ آن تا حدی به نحوه طرح سوال بستگی دارد؛ بنابراین ممکن است در زبانها یا پرسشهای مختلف پاسخهای متفاوتی بدهد. برای دریافت پاسخ دقیقتر بهتر است پرسشهای مشخص و محدود درباره آنچه مستقیماً در تصویر دیده میشود مطرح شود و از سؤالهای کلی مانند «آیا این واقعی است؟» پرهیز شود.